Das dritte HanDiRob-Meeting #2

Als Nächstes präsentierten Andreas Sørensen, Rasmus Junge und Daniel Holm ausführlich den Entwicklungsverlauf der mobilen Unit in Bezug auf die Hardware und Software.

1.Hardware

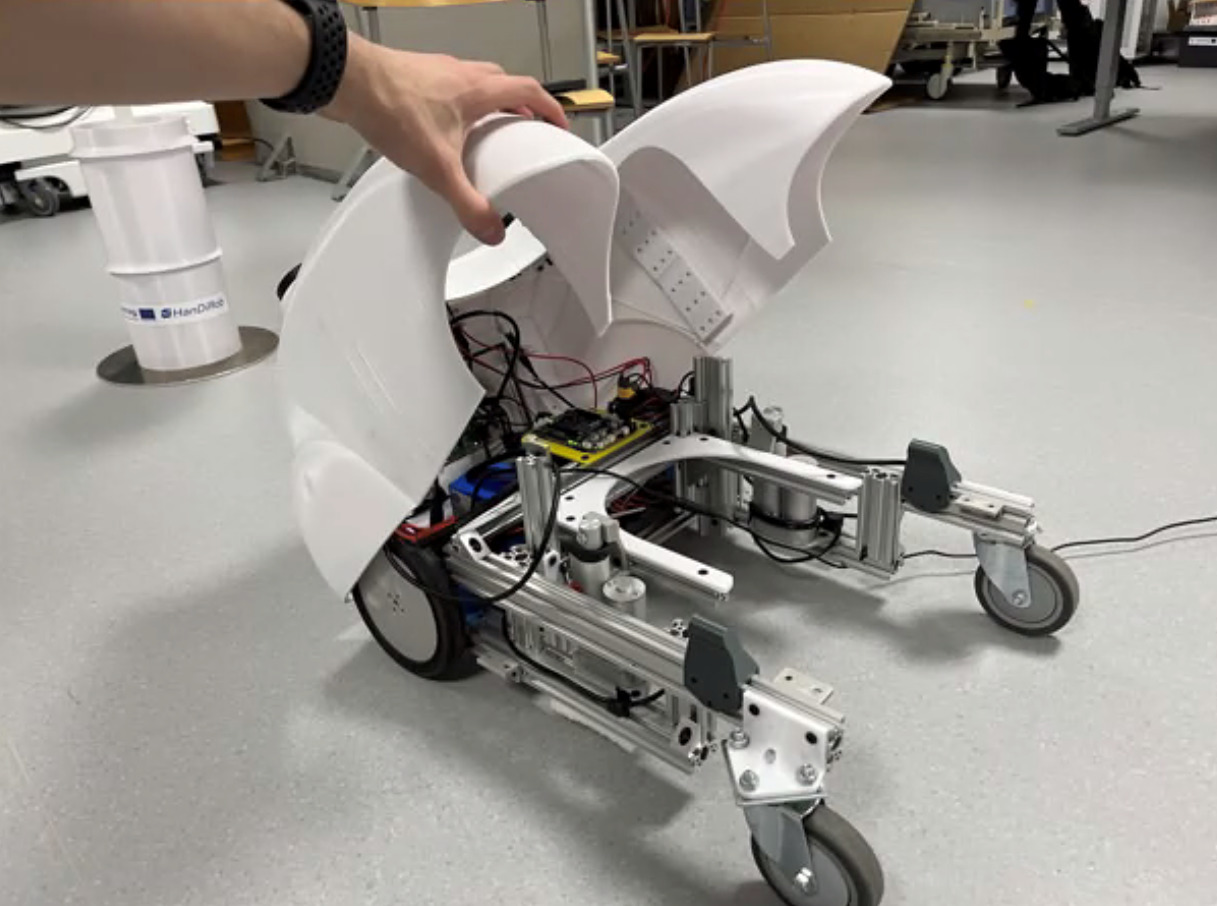

Das Team SDU druckte das Gehäuse der mobilen Unit nach. Es wurde strukturell viel verändert, zum Beispiel, wurden viele Befestigungslöcher für zukünftige Erweiterungen eingebaut, so dass das Gehäuse hoffentlich nicht mehr erneut gedruckt werden muss. Das neu gedruckte Gehäuse ist viel besser und stabiler als das Vorherige.

Außerdem wurden Scharniere angebracht, damit das Gehäuse durch Anheben von hinten geöffnet werden kann. Das soll sehr gut funktionieren und sei ziemlich stabil.

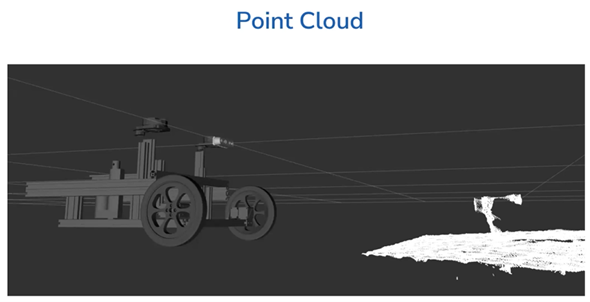

Daneben wurde ein neues Lidar (eine Abkürzung von „Light detection and ranging“) eingesetzt. Unter einem Lidar versteht man ein Radar, das nicht mittels Radiowellen, sondern mit Licht funktioniert. Das Lidar wird zur Umfelderfassung verwendet, genauer gesagt, um Objekte zu erkennen und zu kategorisieren. Im HanDiRob Projekt spielt das eine große Rolle, da die mobile Unit nur mit seiner HIlfe die Wände und Hindernisse erkennen und sich dadurch navigieren kann. Das SDU Team erklärte, dass es für HanDiRob ein neues Lidar vom Typ RP-A1 eingesetzt wird, da der Vorgänger zum einen laut war, und zum anderen durch Licht beeinflusst wurde. Das Team hat das Lidar RP-A1 als Alternative außerkoren, es hat eine höhere Reichweite und Auflösung und kostet genauso viel wie der Vorgänger. Während das alte nur eine Reichweite von 3m hatte, ist das neue in der Lage, Objekte bis zu einer Entfernung von 6m zu erkennen.

Des Weiteren wird, als Ergänzung zum Lidar, eine Tiefenkamera (Depth Camera) verwendet. Da das Lidar auf der Oberseite der mobilen Unit angebracht ist, lässt sich alles, was sich unterhalb dieser Höhe befindet, leider nicht erfassen. Hierbei erkennt die Tiefenkamera alle kleineren Objekte, die sich nicht durch das Lidar detektieren lassen.

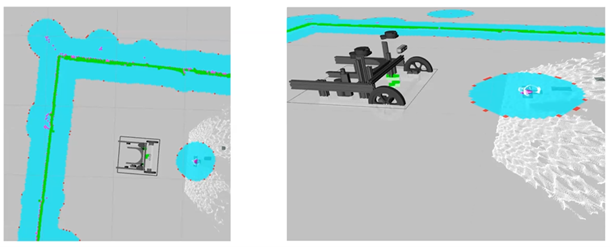

Das Foto zeigt eine Aufnahme der Tiefenkamera. Sie kann die Tasse vor dem Roboter erkennen, obwohl sie auf dem Boden steht, die durch das Lidar nicht erfasst werden kann. Durch die Zusammenarbeit des Lidars und der Tiefenkamera werden nicht nur Wände, sondern auch Hindernisse, die sich nicht auf Höhe des Lidars befinden, erkannt. Die blaue Zone auf dem Foto unten bezeichnet den Bereich, den die mobile Unit beim Fahren umgehen sollte.

2. Software

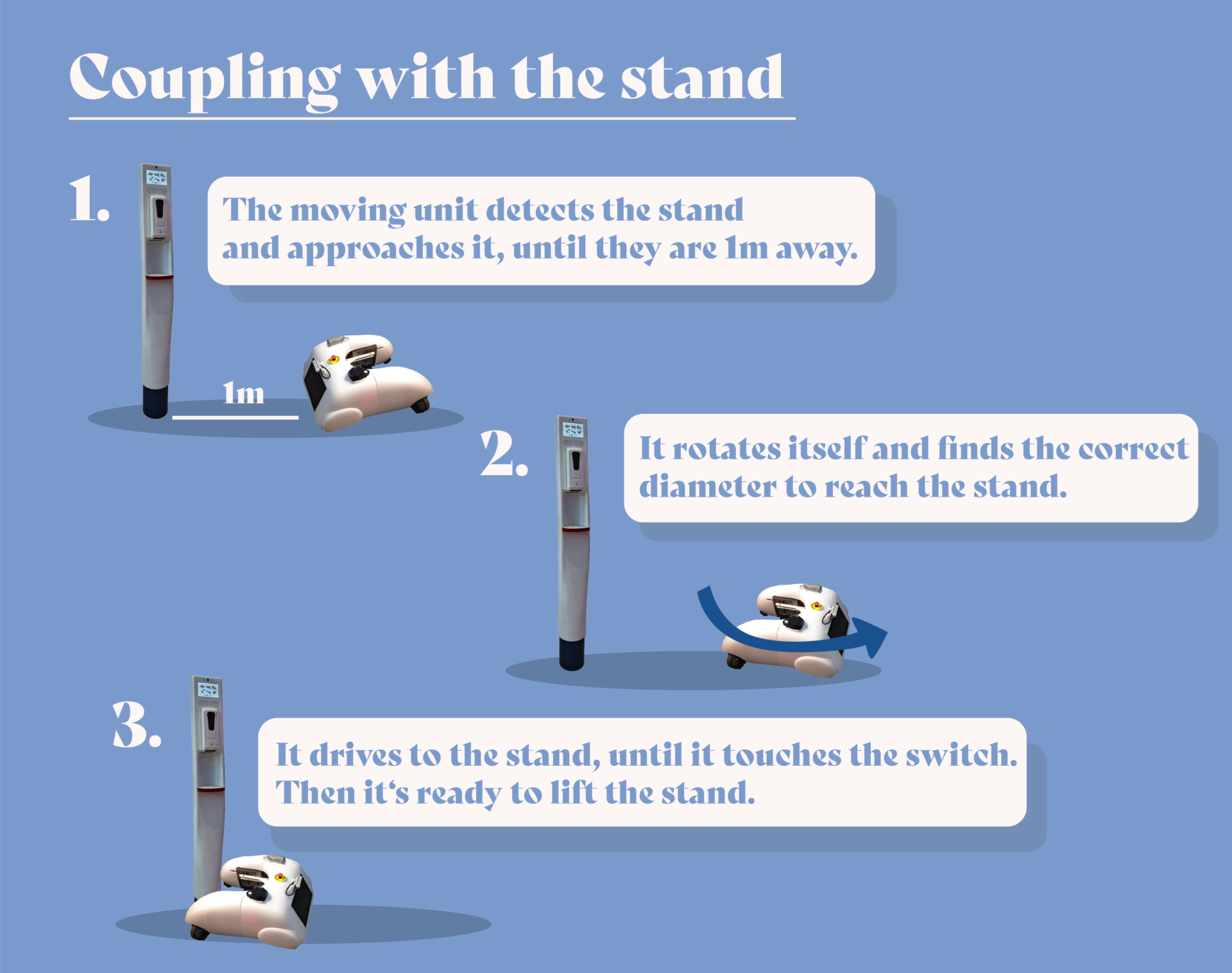

Die mobile Unit sollte in der Lage sein, Menschen zu erkennen und auf sie zuzufahren. Diesbezüglich hat das Team ebenfalls Forschritte gemacht. Mittels „Intel RealSense“ kann der Roboter Menschen in hoher Genauigkeit detektieren, in welcher Richtung sie stehen und in welche Richtung sie sich bewegen. Wenn der Roboter Menschen erkennt, lokalisiert er sie auf seiner internen Karte. Der gleiche Algorithmus kommt ebenso bei der Erkennung der stationären Unit zum Einsatz. Die mobile Unit sollte die stationäre Unit detektieren, zu ihr fahren und sich mit ihr koppeln können. Derzeit kann der Roboter die stationäre Einheit, bei einem Abstand von etwa 5m zu ihr erkennen.

Als Letztes wurde auf die Entwicklungen bei Behavior Tree und der Schnittstelle eingegangen. Für das Verhalten des Roboters implementiert das Team SDU derzeit Behavior Trees, eine grafische Programmierung, in der das Verhalten des Roboters nicht nur schnell, sondern auch bis hinab zum abstrakten Niveau entwickelt werden kann. Die Schnittstelle wird in Form von einem Gesicht mit zwei Augen umgesetzt. Das Team erläuterte, dass sie so einigermaßen gut Emotionen ausdrücken können, und so mutuale Augenkontakte provozieren können. Der Augenkontakt spielt eine wichtige Rolle, um die Aufmerksamkeit der Menschen zu erregen und um Nachrichten zu vermitteln.

Warum ist der Augenkontakt, bzw. Blick bei der HRI (Human Robot Interface) von großer Bedeutung? Diesen Zusammenhang erklärt Oskar Palinko, Assistent Professor bei der SDU im Folgenden:

Text und Grafiken: Jihyun Lee

HanDiRob wird gefördert durch Interreg Deutschland-Danmark mit Mitteln des Europäischen Fonds für regionale Entwicklung. Erfahren Sie mehr über Interreg Deutschland-Danmark

unter www.interreg5a.eu